Wichtigste Neuerungen der Version 3.0

Release-Datum: 27.07.2023 - Patchlevel 3.0.2.2

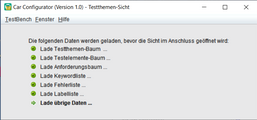

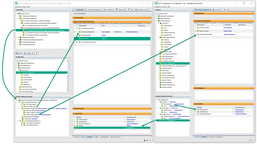

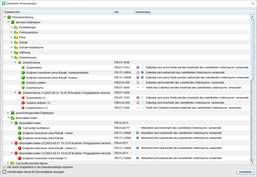

Neuer Fenstermanager: Sichten öffnen eigene Fenster

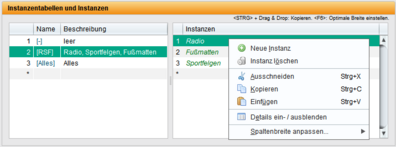

Die Sichten öffnen sich nicht mehr innerhalb des Client-Fensters, sondern als eigene Fenster des Betriebssystems.

Das Wechseln zwischen den Fenstern kann über ALT-TAB erfolgen. Von allen Fenstern aus sind alle Fenster über die jeweilige Statuszeile erreichbar.

Das Zuordnen von Elementen via Drag & Drop erfolgt Fenster-übergreifend, auch über mehrere Bildschirme hinweg.

Die Fenster besitzen eine Fortschrittsanzeige und werden beim Starten des Clients exakt wieder hergestellt (Größe, Position, Bildschirm).

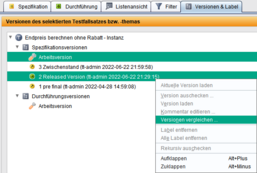

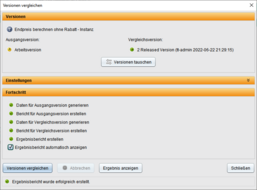

Vergleichen von Versionen

Versionen von Testfallsätzen und Testelementen können verglichen werden. Das Ergebnis wird im Browser als Webseite geöffnet.

Der Vergleich und der zu vergleichende Inhalt kann individuell eingestellt werden.

Schnellzugriff auf Plugins

Für die Spezifikation und die Durchführung kann jeweils ein Plugin festgelegt werden, das als zusätzlicher Button in den Verwaltungsinformationen der Spezifikation und unter den Buttons zum Starten der manuellen Testdurchführung erscheint.

Über diese Button kann das Plugin direkt ohne Umwege ausgeführt werden.

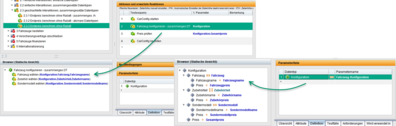

Aus Browser zuordnen und textuelle Schritte darin anzeigen

Zur Anzeige der Struktur von Elementen können diese in den Browser gezogen werden.

Alle angezeigten Elemente können jetzt aus dem Browser überall zugeordnet werden.

Im Browser werden die ersten Zeichen aus der Beschreibung der textuellen Testschritte als deren Name angezeigt.

(Gleiche Funktionsweise wie im iTORX)

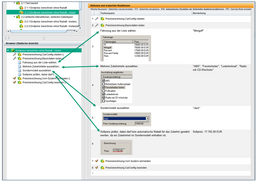

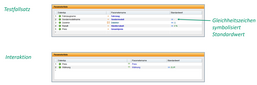

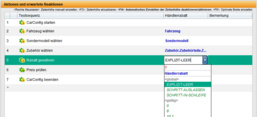

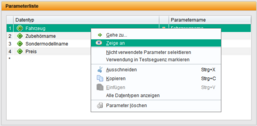

Standardwerte für Parameter

In den Parameterlisten von Testfallsätzen und Interaktionen können für Parameter Standardwerte festgelegt werden.

Werden für Testfallsätze neue Testfälle angelegt, werden statt des "roten ?" die Standardwerte aus der Parameterliste eingesetzt.

Beim Aufruf von Interaktionen in Testsequenzen werden ebenfalls statt des "roten ?" die Standardwerte eingesetzt.

In Testsequenzen können die Standardwerte aus der Parameterliste einer aufgerufenen Interaktion per Tastaturkürzel STRG-M direkt gesetzt werden.

Wird ein anderer Standardwert gesetzt, ändern sich auch alle mit dem Standardwert vorbelegten Werte.

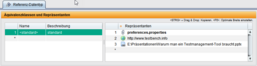

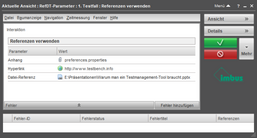

Referenzen direkt als Parameterwerte verwenden

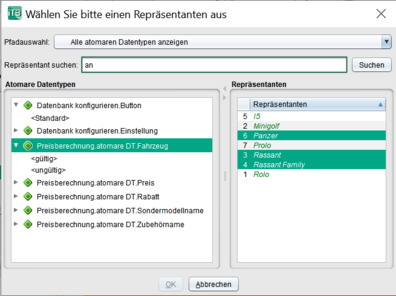

Ein neues Testelement, der Referenzdatentyp, erlaubt es, dass Referenzen (Anhänge, Dateireferenzen, Hyperlinks) direkt als Repräsentanten genutzt werden können.

Referenzdatentypen sind atomare Datentypen, deren Repräsentanten genauso verwendet werden können, wie die Repräsentanten der Standard-Datentypen.

Die Repräsentanten der Referenzdatentypen können über ein vorangestelltes Icon von normalen Repräsentanten unterschieden werden.

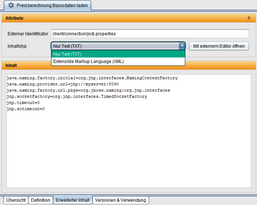

Erweiterter Inhalt für Interaktionen

Zusätzlich zur Beschreibung können Interaktionen noch weitere Informationen verwalten. Die Inhalte erhalten einen Typ, so dass sie besser dargestellt und extern verarbeitet werden können.

In diesen erweiterten Inhalten können z.B. Steuerdaten oder Code-Schnipsel in der Testdurchführung genutzt werden.

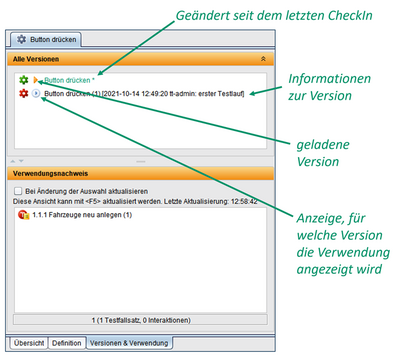

Versionen und Verwendungen der Testelemente zusammengelegt

Zur besseren Übersicht befinden sich jetzt für Testelemente die Versionen und Verwendungen auf einer gemeinsamen Tabkarte.

Weiterhin wurde ergänzt:

- Informationen zur Version

- Barrierefreie Visualisierung der geladenen Version

- Änderungsmarker

Detaillierte Verwendung von Testelementen anzeigen

In der Testelementesicht können für ein Testelement alle seine Verwendungen angezeigt werden. Die Verwendungen werden für alle Versionen des Testelements angezeigt.

Für jede Verwendung wird zusätzlich ausgewiesen, ob die Verwendung innerhalb oder außerhalb des zugehörigen Unterbaumes liegt. Bei Datentypen wird auch der Verwednung seiner Repräsentanten berücksichtigt.

Die detaillierten Verwendungen können auch für alle Elemente einer Subdivision angezeigt werden. So kann z.B. ermittelt werden, ob eine Subdivision gelöscht werden kann oder noch Verwendungen außerhalb der Subdivision bestehen.

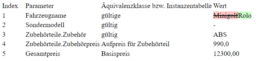

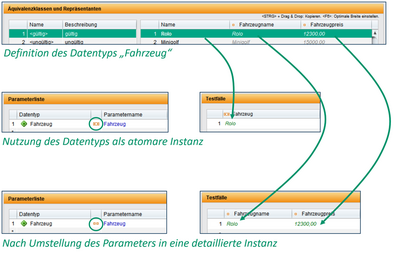

Atomare in detaillierte Instanz verlustfrei wandeln

Wird der Parameter eines Testfallsatzes nachträglich von einer atomaren Instanz in eine detaillierte Instanz umgewandelt, werden die Werte der zugrundeliegenden Unterdatentypen in der Testfalltabelle eingetragen.

Gleiches gilt entsprechend für die Umwandlung einer detaillierten in eine atomare Instanz.

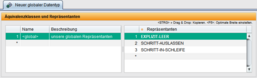

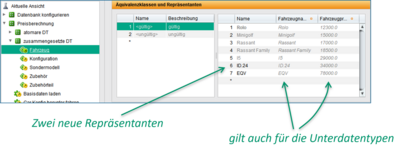

Testobjektversions-weite Repräsentanten

Für Werte mit bestimmten Semantiken ist es sinnvoll diese Werte nicht in jedem Datentypen erneut festzulegen, sondern eine Möglichkeit zu haben diese Werte an einer zentralen Stelle zu definieren.

Solch ein Wert kann z.B. der "explizit leere Wert" sein, so dass überall einheitlich ein Wert auf explizit leer gesetzt werden kann.

Dazu dient ein weiteres, neues Testelement, der globale Datentyp. Dessen Repräsentanten können in den Auswahllisten anderer Datentypen der gleichen Testobjektversion ausgewählt werden. Dazu muss für diese anderen Datentypen die Nutzung der globalen Datentypen erlaubt werden.

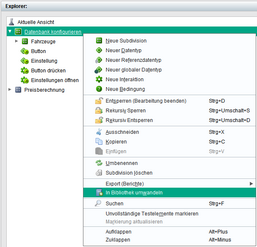

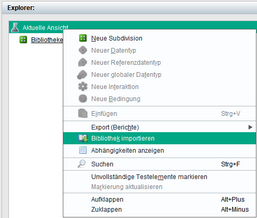

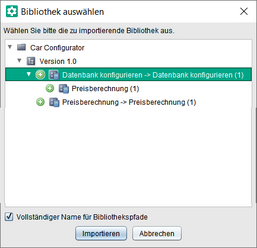

Testelementebibliotheken

Testelemente (Interaktionen, Datentypen und Bedingungen) können in Bibliotheken innerhalb einer Testobjektversion zentral zusammengefasst werden. Diese Bibliotheken können in anderen Testobjektversionen genutzt werden.

Die Grundfunktionen sind:

- Konsistente Stände der Elemente einer Bibliothek werden als Baselines erzeugt und versioniert.

- Aktualisieren auf neue Versionen (= neue Baselines) einer Bibliothek ist möglich.

- Die Testelemente einer Bibliothek sind in der verwendenden Testobjektversion schreibgeschützt, können also nur zentral geändert werden.

- Bibliotheken können Abhängigkeiten zu anderen Bibliotheken besitzen.

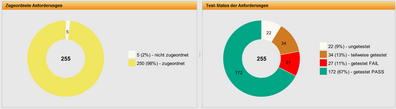

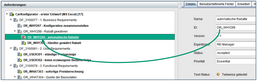

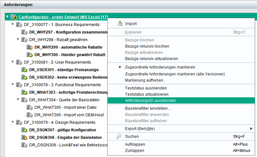

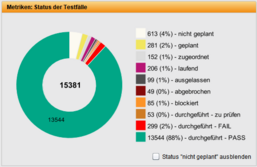

Anforderungsabdeckung und Verteilung des Testergebnis-Status

In der Anforderungsverwaltung werden für Baselines Metriken zur Abdeckung der Anforderungen durch Tests und zur Verteilung des Testergebnis-Status der Anforderungen angezeigt.

Sind mehrere Baselines vorhanden, werden die Metriken auch über alle Baselines insgesamt ausgegeben.

Im Kontextmenü einer Metrik kann die Grafik gespeichert oder gedruckt werden.

Anforderungs-ID im Anforderungsbaum anzeigen

Die ID einer Anforderung kann im Baum der Anforderungen eingeblendet werden.

Die ID einer Anforderung wird, im Vergleich zum Titel, häufiger zum Identifizieren einer Anforderung verwendet und ist nun direkt sichtbar.

Wichtigste Neuerungen der Version 2.6.1

Release-Datum: 15.12.2020

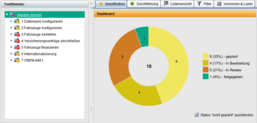

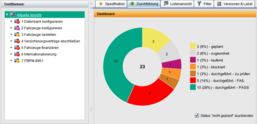

Statusverteilung der Testspezifikation

In jedem Testthema wird die Verteilung des Status im Teilbaum angezeigt.

Im Kontextmenü der Metrik kann die Grafik gespeichert oder gedruckt werden.

Für die Wurzel des Testthemenbaums, der Aktuellen Ansicht, wird die Statusverteilung für den gesamten Baum angezeigt.

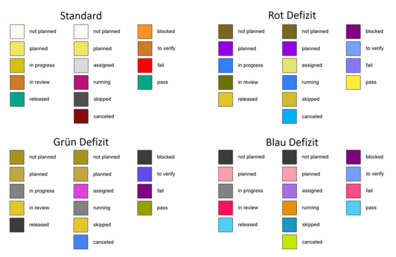

Barrierefreiheit

Die Farben der Grafiken können für jeden Client angepasst werden.

Im "bin"-Verzeichnis des Clients existiert die Datei "nimbus.properties", in der die Farben definiert sind.

Es sind Vorschläge für die verschiedenen Farbdefizite gespeichert, die jeder Benutzer individuell an seine Bedürfnisse anpassen kann.

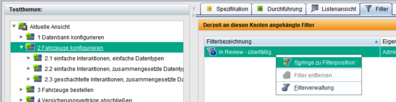

Die Position eines Filters finden

Tief verschachtelte Bäume enthalten oft viele verschiedene Filter an verschiedenen Positionen der Bäume. Die Position eines Filters kann nun leicht im Baum gefunden werden.

Ein Doppelklick auf den Filternamen springt in der Filterverwaltung zur Definition des Filters.

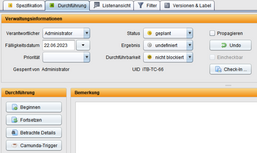

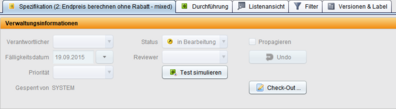

Direktes Auschecken neuer Versionen

Vom System eingecheckte (gesperrte) oder geladene Versionen können sofort ausgecheckt werden, ein Wechsel zur Versionsliste ist nicht mehr notwendig.

In diesen Fällen ändert sich der Button zum Einchecken in den Button zum Auschecken.

Details der zugeordneten Anforderungen

Die Details einer Anforderung werden direkt in der Testspezifikation angezeigt. Der Wechsel in die Anforderungsverwaltung kann entfallen.

Dies gilt für Anforderungen an Testthemen und Testfallsätzen.

Parameter-Titel der Testsequenzen

Die Tabellentitel der Parameter in der Testsequenz passen sich den Parametern der ausgewählten Zeile an.

Es werden die Parameternamen der aufgerufenen Interaktion angezeigt, die auch im Tooltip des Parameters angezeigt werden.

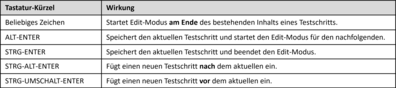

Testschritte austauschen

Testschritte in Testsequenzen können per Drag & Drop oder über das Kontextmenü ausgetauscht werden. Dies funktioniert auch für textuelle Testschritte.

Gleiche Parameter werden von links nach rechts wiederverwendet.

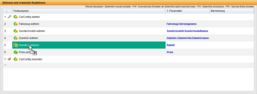

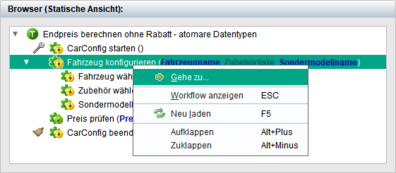

"Gehe zu" aus dem Browser (Statische Ansicht)

Der Browser wird zur Visualisierung von Strukturen im Keyword Driven Test und Data Driven Test verwendet. Das Springen zu den darin angezeigten Elementen ist nun möglich.

Die bestehenden Funktionalitäten sind nun auch über das Kontextmenü verfügbar.

Verwendete Testelemente identifizieren

Interaktionen, die in Testsequenzen von Testfallsätzen verwendet werden, können in der Hilfsobjektanzeige identifiziert werden.

Ein Doppelklick auf den Namen hat die gleiche Funktion.

Ein Doppelklick in der Zahlenspalte springt zum Element in der Testelementesicht.

Statusverteilung der Testdurchführung

In jedem Testthema wird die Verteilung des Status im Teilbaum angezeigt. In der Testdurchführung werden die Testfälle gezählt.

Im Kontextmenü der Metrik kann die Grafik gespeichert oder gedruckt werden.

Für die Wurzel des Testthemenbaums, der Aktuellen Ansicht, wird die Statusverteilung für den gesamten Baum angezeigt.

Offline Entwicklung von MS Word basierten Berichten

Microsoft Word-Berichte können mit dem Kommandozeilen-Tool generate-word-report.bat oder generate-word-report.sh erstellt werden.

Lokal gespeicherte XML-Berichte werden direkt verarbeitet. Ein Export über den Client ist während der Entwicklung damit nur einmal erforderlich.

Das Paket kann über support(at)imbus.de angefordert werden.

Wichtigste Neuerungen der Version 2.6

Release-Datum: 21.01.2020

Erweiterung von freigegebenen Datentypen

Die Bausteine (Testelemente) des Keyword-Driven Tests sind ab dem Moment, ab dem sie den Status "freigegeben" erhalten für alle Änderung gesperrt. Werden Datentypen an weiteren Bausteinen oder Tests verwendet besteht jedoch häufig die Notwendigkeit, dass auch neue Werte in die Äquivalenzklassen und Datentabellen eingefügt werden müssen, da die bestehenden nicht ausreichend sind. Bisher wurde in solchen Fällen der Datentyp wieder in den Status "in Bearbeitung" zurück gesetzt, was dann auch zur Auflösung der Freigabe aller ihn verwendenden Elemente führte.

Ab sofort können zusätzliche, neue Werte auch in freigegebenen Datentypen erfasst werden, d.h. sie müssen nicht mehr auf den Status "in Bearbeitung" zurück gesetzt werden.

Zum Zeitpunkt der Freigabe bestehende Daten und Werte können natürlich weiterhin nicht geändert werden.

Interaktionen und Datentypen direkt in statische Ansicht ziehen

Mit den Bausteinen (Testelemente) des Keyword-Driven Tests können sehr komplexe Strukturen sehr komprimiert modelliert werden. Um die Komplexität eines Testelementes auf einen Blick zu erfassen, kann die statische Ansicht des Testelemente-Browsers genutzt werden.

Ab sofort können Testelemente direkt aus der Position ihrer Verwendung innerhalb von Testsequenzen oder Parameterlisten in die statische Ansicht gezogen werden. Damit wird die Analyse von bestehenden Testdefinitionen wieder etwas einfacher und schneller.

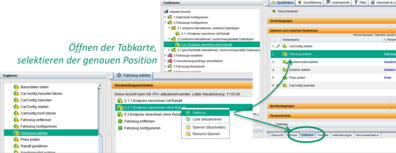

Exakt an Stelle der Verwendung springen

Für jedes Element in der TestBench wird gespeichert, welche anderen Elemente dieses Element verwenden bzw. aufrufen. So ist immer leicht ermittelt, welche Elemente z.B. von Änderungen betroffen sind oder welche Tests nach einer Änderung wiederholt werden müssten. Aus diesem sogenannten Verwendungsnachweis kann direkt zum Verwender gesprungen werden.

Ab sofort wird direkt zur Position der Verwendung innerhalb des Verwenders gesprungen. Für z.B. Interaktionen (Keywords des Keyword-Driven Test) wird direkt in die Testdefinition gesprungen und darin die Position der Interaktion innerhalb der Testsequenz markiert.

Damit wird das Springen zwischen Elementen spürbar vereinfacht und beschleunigt. Auswirkungsanalysen von Änderungen werden vereinfacht.

Zuordnen von Fehlern optimiert

Die Zuordnung von Fehler an Testfällen kann jetzt einfacher erfolgen:

- Testfälle müssen nicht mehr vorausgewählt werden, sondern Fehler können direkt einem Testfall in der Liste der Testfälle zugeordnet werden.

- Fehler können allen Testfällen gleichzeitig zugeordnet werden oder von allen Testfällen gleichzeitig entfernt werden.

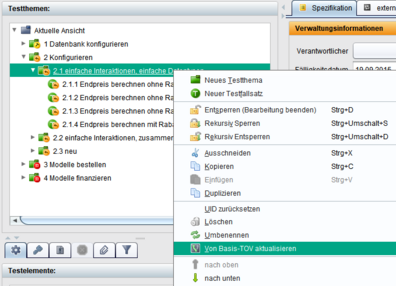

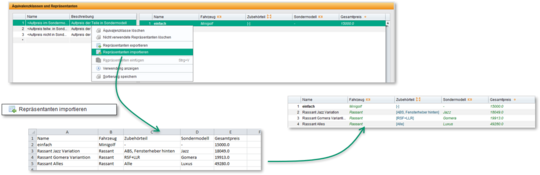

Aktualisieren einer Variante

Im Rahmen des Variantenmanagements können jetzt Änderungen innerhalb einer Basis-Testobjektversion (Basis-TOV) in bereits abgeleitete Varianten übernommen werden. Die Übernahme erfolgt manuell aus der Variante, damit Varianten kontrolliert und nur wenn wirklich der Bedarf einer Aktualisierung besteht, aktualisiert werden können.

Es können vollständige Varianten, einzelne Teilbäume des Testthemenbaumes oder einzelne Tests aktualisiert werden.

Weiterhin besteht die Möglichkeit neue Elemente aus der Basis-TOV in eine Variante zu kopieren. Dabei erfolgt automatisch die Ableitung für die Variante.

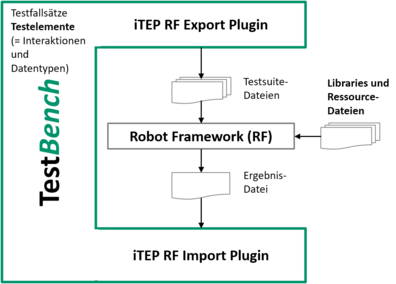

Neue Plugins zur Anbindung des Robot Frameworks

Die Anbindung des Robot Frameworks an die Testautomatisierungsschnittstelle der TestBench wurde neu implementiert.

Es stehen jetzt drei Plugins zur Verfügung:

- Robot Framework Export-Plugin

Dient der Aufbereitung der Testspezifikation zur Ausführung der automatisierten Tests mit dem Robot Framework.

Die Tests können bei Bedarf direkt aus dem Plugin aufgerufen werden. - Robot Framework Import-Plugin

Dient der Übernahme der Testergebnisse aus dem Robot Framework in die TestBench. - Robot Framework Library Import-Plugin

Rund um das Robot Framework existiert eine große Anzahl an Bibliotheken um die Testspezifikation bestimmter Systeme oder Umgebungen zu erleichtern. So stehen z.B. etliche Bibliotheken rund um Selenium zur Verfügung. Mithilfe des Plugins können die Bibliotheken in die TestBench importiert werden und stehen dort als Testelemente im Keyword-Driven Test zur Verfügung. So können Tests spezifiziert werden die quasi out-of-the-box automatisiert ausgeführt werden können.

Testing Intelligence: Darstellung der Diagramme speichern

Die Einstellungen für die Darstellung der Diagramme im Metrik-Addon Testing Intelligence werden jetzt permanent gespeichert:

- Gruppierte oder gestapelte Anzeige der Balkendiagramme

- Ausgeblendete Status

Ausgeblendete Status können durch einfachen Klick auf die Legende wieder eingeblendet werden.

Sollen diese Status unsichtbar werden, können sie vollständig aus der Darstellung entfernt werden.

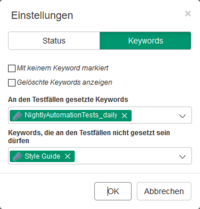

Testing Intelligence: Filtern nach Keywords

In der TestBench ist der meistgenutzte Mechanismus Test zu markieren bzw. zu Mengen zusammenzufassen, die Zuordnung von Keywords zu Tests.

Z.B. kann ein Keyword alle jede Nacht automatisiert auszuführenden Tests markieren, nach denen dann gefiltert werden kann um z.B. Berichte oder Auswertungen über die nächtlichen Testläufe zu generieren.

Dieser Mechanismus der Filterung nach Keywords steht jetzt auch direkt in Testing Intelligence zur Verfügung, d.h. die in den Metriken angezeigten Daten können jederzeit nachträglich mithilfe der in TestBench gesetzten Keywords gefiltert werden.

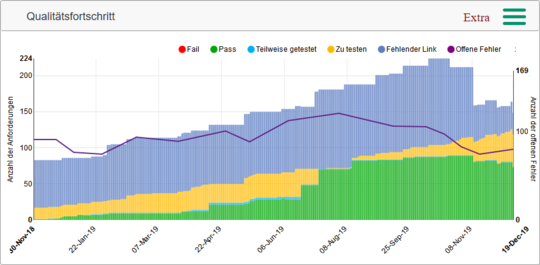

Testing Intelligence: Neue Metrik zum Qualitätsfortschritt

Testing Intelligence verfügt über eine neue Metrik, die den Verlauf der Qualität eines Systems darstellt. Dazu werden die Testergebnisse der Anforderungen zur Anzahl der offenen Fehler in Relation gesetzt.

So lässt sich über die Zeit gut ablesen, wie sich die Abdeckung der Anforderungen mit Tests und die Anzahl der Fehler im Laufe der Zeit entwickelt und ob ein Testende demnächst erreicht werden kann.

Wichtigste Neuerungen der Version 2.5.4.1 (minor Version)

Release-Datum: 02.07.2019

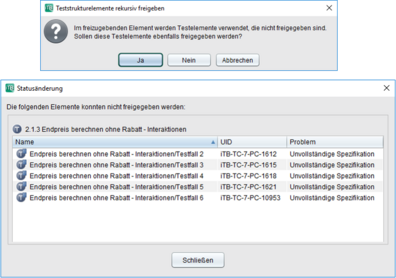

automatische Freigabe von Unterelementen

Bisher mussten beim Setzen des Status von Tests auf "freigegeben" bereits auch alle darin verwendeten Unterelemente den Status "freigegeben" besitzen.

Jetzt kann diese Freigabe in einen Schritt erfolgen, d.h. werden Tests freigegeben, kann der Benutzer gleichzeitig alle verwendeten Unterelemente ebenfalls freigeben. Können davon Elemente nicht freigegeben werden, werden dem Benutzer diese Elemente mitgeteilt und der Grund aufgeführt, warum die Freigabe nicht möglich ist, so dass diese Elemente zielgerichtet korrigiert werden können.

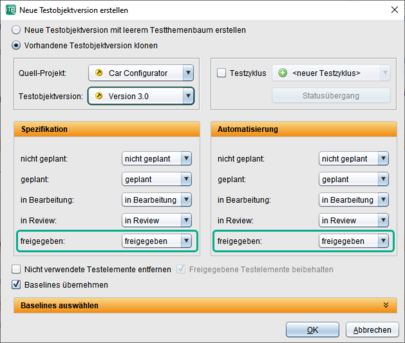

Freigegebene Elemente in neue Versionen übernehmen

Beim Erstellen einer neuen Testobjektversion (Testspezifikation für eine bestimmte Version des zu testenden Systems) auf Basis einer bestehenden Testobjektversion wurden alle darin freigegebenen Elemente auf den Status "in Review" zurück gesetzt. Jetzt kann auch der Status "freigegeben" erhalten bleiben. Neben der Testspezifikation gilt dies auch für den Status der Testautomatisierung.

Geschwindigkeit und Speichermanagement der Anbindung der Testautomatisierung

Das Speichermanagement der Steuerung der Testautomatisierung wurde vollständig überarbeitet.

Der maximale Speicherverbrauch orientiert sich jetzt am größten Test und nicht mehr an der Größe des gesamten Testlaufs.

Gleichzeitig konnte eine deutliche Verbesserung des Ablaufgeschwindigkeit erreicht werden, was sich gerade bei großen Testläufen sehr stark bemerkbar macht.

Neue Berichte im Anforderungsmanagement

Die bestehenden Berichte des Anforderungsmanagements wurden um zwei weitere Berichte, jeweils in Deutsch und Englisch, ergänzt:

Traceability Matrix

Die Testergebnisse der zu testenden Anforderungen werden übergreifend über mehrere Testobjektversionen und Testzyklen tabellarisch dargestellt. Es lässt sich sehr schnell ablesen, welche Anforderungen erfolgreich getestet wurden und welche Anforderungen noch Probleme bereiten.

Detaillierter Bericht zum Status der Anforderungen

Bericht auf Basis von MS Word mit allen Details der getesten Anforderungen, den damit verknüpften Tests und deren Ergebnissen

Wichtigste Neuerungen der Version 2.5.4

Release-Datum: 30.10.2018

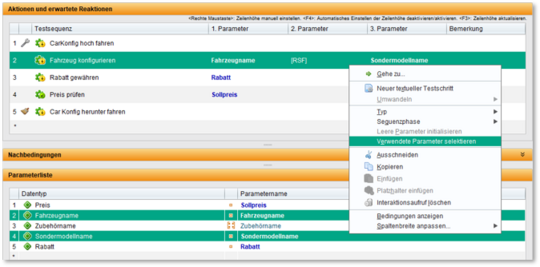

Phasen in der Testsequenz

Ein Testschritt innerhalb einer Testsequenz kann jetzt einer von drei Phasen zugeordnet werden

- Vorbereitung (Setup)

- Testschritt

- Nachbereitung (Teardown)

Diese drei Phasen stehen sowohl beim manuellen Testen bei Nutzung des Testassistenten für manuelle Testdurchführung, als auch bei der automatisierten Testdurchführung für alle angeschlossenen Testautomaten zur Verfügung.

Verwendete Parameter ermitteln

Innerhalb der Testsequenz kann für einen Testschritt ermittelt werden, welche der Parameter aus der Parameterschnittstelle des Tests von diesem Testschritt verwendet werden.

So kann im Data-Driven Test auch bei intensiver Nutzung von Parametern die Schnittstelle effektiv gewartet und alle Vorteile des Daten-Driven Tests genutzt werden.

Diese Funktionalität kann auch für die Untertestsequenzen von zusammengesetzten Testschritten verwendet werden.

Ebenso können umgekehrt die verwendenden Testschritte eines Parameters ermittelt werden und, z.B. im Rahmen eines Refactorings, nicht mehr verwendete Parameter identifiziert werden.

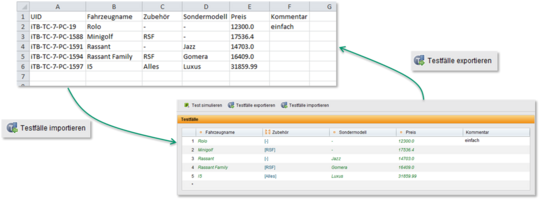

Import und Export von Testfällen

Die Datentabelle der Testfälle kann exportiert bzw. importiert werden.

Parameter und Parameterkombinationen können außerhalb verändert, ermittelt oder entfernt werden. Die mächtigen Funktionen einer Tabellenkalkulation bieten dabei viele Möglichkeiten.

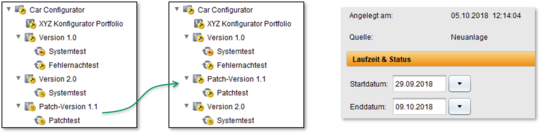

Projektbaum nach Datum anordnen

Die Versionen von Testobjekten, als Träger der Testspezifikations-Informationen dieser Version und deren Testzyklen, als Träger der Testergebnis-Informationen, werden jetzt zuerst nach dem eingetragenen Startdatum, dann nach dem Enddatum und dann erst, wie bisher, nach dem Anlagedatum angeordnet.

Die Projektstruktur ist leichter an die tatsächliche Versionsfolge anpassbar und auch nachträgliche Patch- oder Feature-Versionen können an die passende Stelle im Projektbaum eingefügt werden.

Ihr Ansprechpartner bei imbus

Herr Dierk Engelhardt

Mail: info@testbench.com

Tel.: +49 9131 / 7518-0

Fax: +49 9131 / 7518-50